Mica è illegale essere stupidi

E perché non possiamo fare troppo sulla disinformazione, ma qualcosa sì.

Con le elezioni europee sempre più vicine, le homepage dei siti che piacciono a chi gradisce i temi di Artifacts e i report di certi think tank (ri)tornano a parlare di una questione sempreverde:

la disinformazione online.

Che è abbastanza rilevante in un periodo nel quale i cittadini decidono (o confermano) a chi dare il loro voto.

Ursula Von der Leyen, che vorrebbe continuare a fare il lavoro che fa ora, vorrebbe una nuova legge per contrastare le campagne di disinformazione che arrivano da Russia e Cina. Dovrebbe chiamarsi “Europe Democracy Shield”, e farebbe squadra con DSA e AI Act.

Josep Borrell, Alto rappresentante dell’UE per la politica estera, qualche mese fa diceva “unchecked, malicious content spreads like a cancer and puts the health of our democracies at risk”. Anche lui additando la Russia come prima responsabile.

E sì, le campagne di disinformazione che arrivano da paesi extra-UE sono e sono state una minaccia importante. Ma sono solo un pezzo di un puzzle decisamente più complesso.

Proviamo a scomporlo (o a comporlo, come preferisci).

Mark Scott, uno tra i giornalisti più autorevoli sul tech in UE, sostiene che troppa attenzione alla Russia dia l’impressione di un’influenza maggiore a quella che realmente esercita. Ma, soprattutto, ignora che molta della disinformazione che circola in UE è anche confezionata in casa nostra.

E c’è di più. Spesso pensiamo alla disinformazione come mera circolazione di notizie manifestamente false, tipo che i vaccini farebbero morire o che tutti gli omicidi li fanno gli immigrati. La realtà è, come accade spesso, più sfumata.

La disinformazione può essere nel modo di porre i fatti, il cosiddetto framing, ad esempio scrivere “Ormai i cuochi delle nostre città sono tutti stranieri”. Come se fosse necessariamente un problema.

Ma può anche essere ingigantire certe notizie vere, come invadere i feed con un preciso evento selezionato per fare scalpore. Tipo che i soldati ucraini avrebbero compiuto un crimine efferato, come fosse un incidente isolato e che non riguarda l’altra parte dello schieramento.

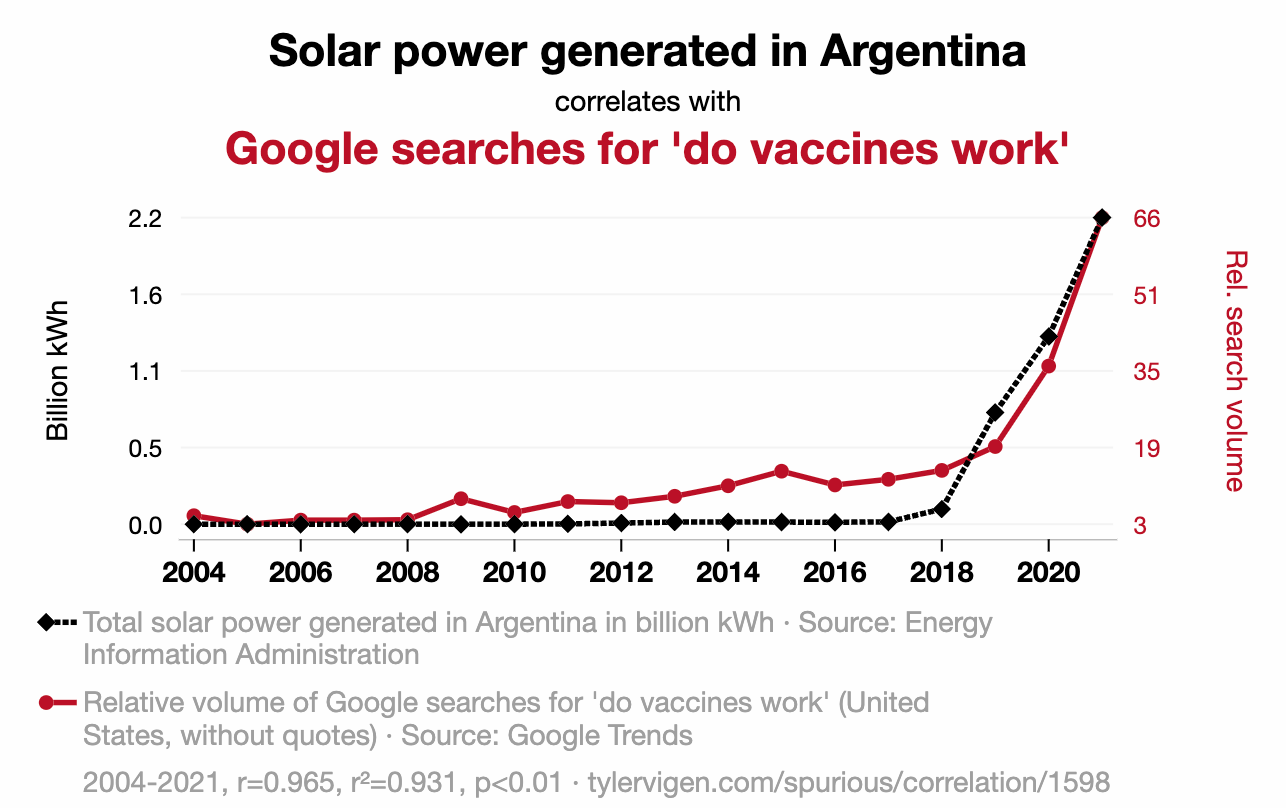

E disinformazione può pure essere collegare due storie vere ma senza nessun legame. Il tradizionale correlation is not causation, tipo questo qui:

Insomma, non è immediato definire cosa sia la disinformazione, e questo è decisamente problematico se vogliamo metterle un freno.

Due notizie ugualmente false sono ugualmente pericolose? Una notizia di Lercio va considerata disinformazione come una fake news fatta circolare da un sito affiliato alla Russia? Con quale criterio giudichiamo? La pericolosità, o forse lo scopo, o l’impatto? Tutte domande davvero delicate.

Forse, lo stesso tentativo di definire un concetto elusivo come la disinformazione è pericoloso o addirittura inutile perché troppo discrezionale. O almeno così sostiene lo Special Rapporteur per la libertà di espressione delle Nazioni Unite.

E non è nemmeno chiaro chi dovrebbe definire cosa sia disinformazione. I governi? Pericolo di derive autoritarie. Le piattaforme? Non chiaro su che basi. Fact-checkers? Da chiarire gli incentivi. Complicato.

Comunque, il cuore di questa vicenda è che la disinformazione non è illegale. È vero che in essa c’è la pericolosa intenzione di ingannare, ma renderla illegale significa limitare la libertà di esprimere delle opinioni (anche fondate su fatti non veri), che è alla base dei sistemi liberali.

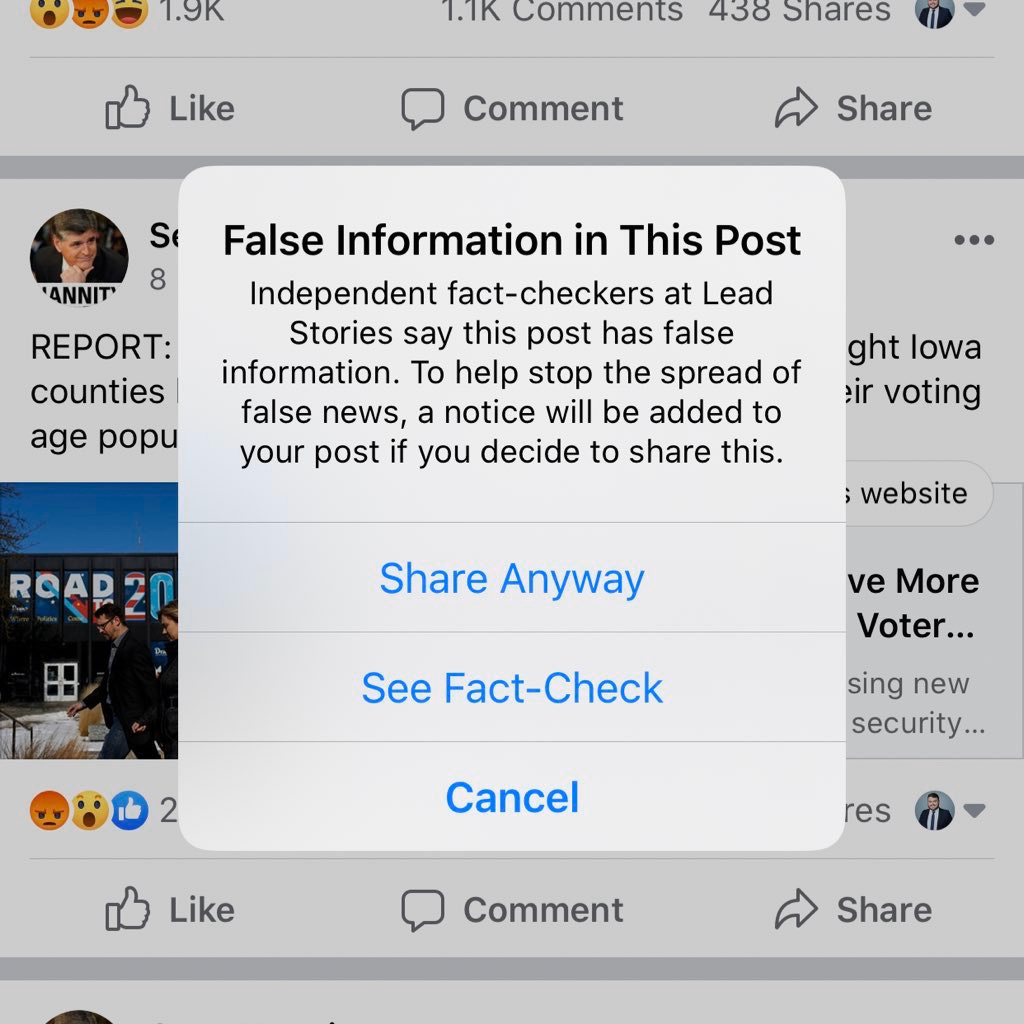

Per questo, è estremamente pericoloso rimuovere tout court certi post, ma è possibile trovare delle contromisure, come limitarne la circolazione sulle piattaforme, aggiungere delle etichette o fornire maggior contesto all’utente.

Anche qui, però, resta un paradosso, un dilemma sottile ma essenziale: qualsiasi azione o decisione che, in qualche misura, limita la possibilità di dire o far circolare una certa informazione o opinione impatta il diritto alla libertà di espressione.

A questa cosa bisogna stare molto attenti, in UE abbiamo gli strumenti per farlo, ma è anche prioritario non oltrepassare una certa linea rossa. Di questo e altro, se ne ragiona in questa Artifacts.

La Storia

Una prima pietra miliare della lotta contro la disinformazione è il “Code of practice of disinformation”, pubblicato nel 2018 per le elezioni europee dell’anno successivo. Nel 2022, poi, è stato aggiornato e rafforzato guadagnando maggiore credito con vari nuovi firmatari.

In quanto Code of Practice, non aveva (e non ha tuttora) forza di legge, ma allinea le piattaforme su strategie per ridurre la disinformazione. Chiaramente, per le piattaforme non è obbligatorio sottoscriverlo, ma si può dire che sia caldamente consigliato. Ad oggi, tra le maggiori piattaforme, solo X non lo sottoscrive o, meglio, ha smesso di farlo dopo l’arrivo di Elon Musk.

Prima o poi i principi che elenca dovrebbero entrare a far parte del Digital Services Act (DSA), ma ancora da capire come.

Ecco, qui bisogna fermarsi e chiarire dei punti chiave sul DSA.

Diversamente da quanto sostengono individui che fanno disinformazione, il DSA in nessun modo vuole essere un Ministero della Verità Orwelliano o allineare i cittadini al fantomatico politicamente corretto. Piuttosto, come abbiamo già visto, l’obiettivo è far sì che ciò che è illegale offline secondo le leggi nazionali dei paesi membri lo sia anche online.

Di conseguenza, dato che - lo ripetiamo - la disinformazione non è illegale, non è il focus primario del DSA. Tant’è che nel regolamento viene menzionata solo nei consideranda e comunque mai definita, diversamente dai contenuti illegali.

Se fossero gli appunti di una lezione, scriverei che c’è una differenza chiara tra i contenuti illegali, come video di abusi sessuali, e quelli pericolosi, come la disinformazione.

Tuttavia, non solo le malelingue ma anche la Commissione e alcuni suoi rappresentanti a volte si lasciano scappare eccesivamente la parola “disinformation” quando si parla di DSA. Un caso abbastanza palese è quello delle recenti linee guida per le piattaforme in vista delle elezioni, dove si parla più volte di disinformazione, tra l’altro senza darne una definizione.

Attenzione: non sto certo denunciando una deriva autoritaria, ma segnalando una tendenza che esula da quello che dovrebbe essere il compito del DSA e un principio chiave per l’enforcement del regolamento.

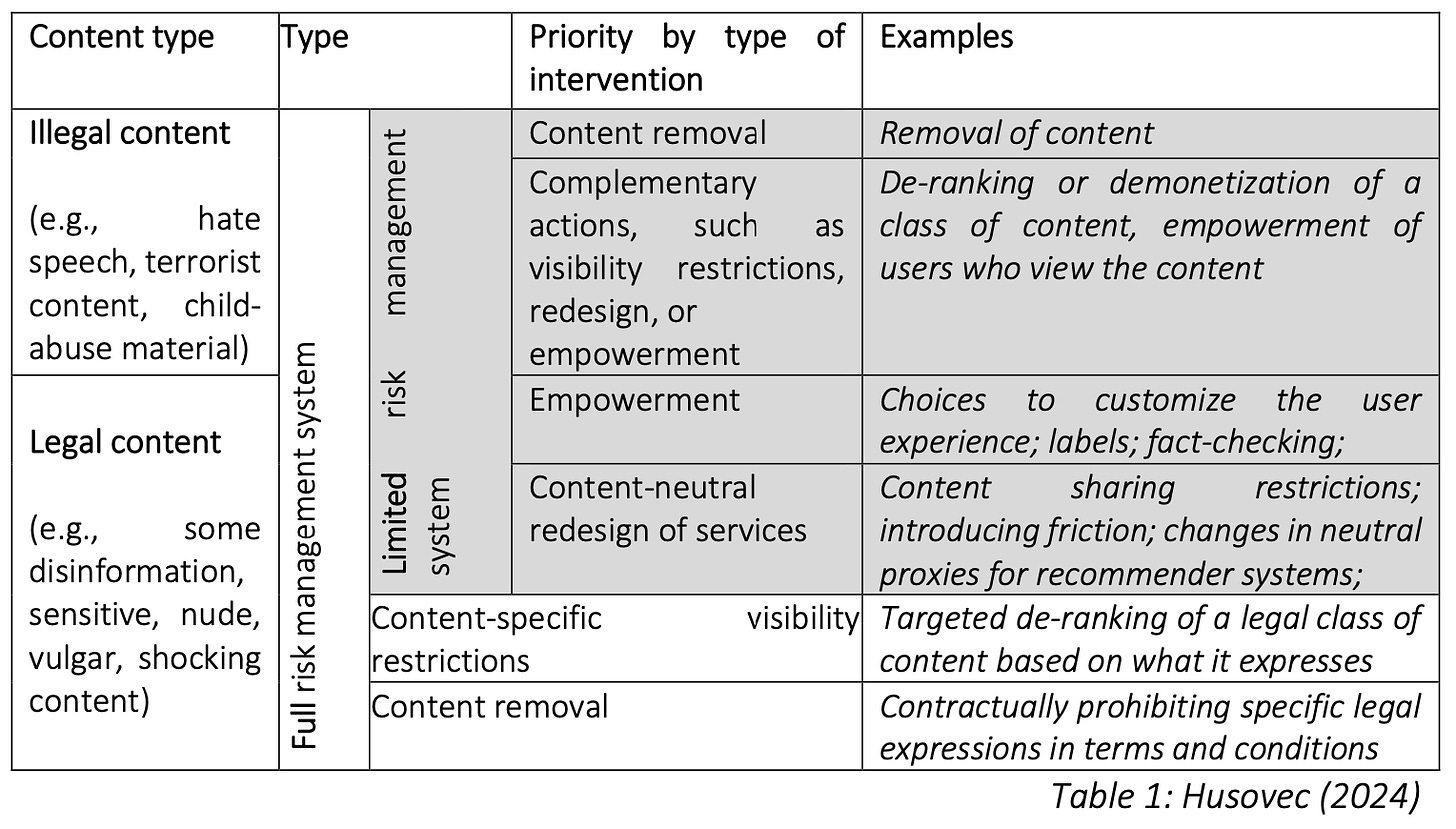

Su questo mi faccio aiutare da Martin Husovec, uno degli accademici migliori su DSA, che ha scritto un paper brillante a riguardo: “The Digital Services Act’s Red Line: What the Commission Can and Cannot Do About Disinformation”.

Dato che il DSA contiene solo le regole su come contrastare qualcosa di illegale, ma non su cosa sia illegale, la Commissione si rifà alle leggi nazionali e le applica ai servizi digitali. In tal senso, ha 2 vincoli essenziali:

quello del principio di legalità (Articolo 49 della Carta dei diritti fondamentali dell’UE), per cui si può essere condannati solo se ciò che si commette o omette è illegale;

e quello per cui il DSA non contiene regole sulla natura dei contenuti.

Di conseguenza, sono giustificate le azioni solo sui contenuti illegali, e non sulla disinformazione, che illegale non è. Dunque, c’è una linea rossa che la Commissione non deve oltrepassare quando chiede di agire sui contenuti presenti sulle piattaforme.

Se, infatti, ha a che fare con rischi posti da contenuti illegali, allora può serenamente chiedere di intervenire. Al contrario, nel caso di rischi posti da contenuti legali, come è spesso il caso per la disinformazione, allora dovrebbe evitare di chiedere di intervenire.

Lo so, può suonare strano, ma la legge è l’unico vincolo solido per evitare qualsiasi rischio di censura o limitazione della libertà di espressione.

A questo punto, allora, potrebbe sembrare che le “armi” che abbiamo contro la disinformazione siano spuntate o inutili. Ma non è proprio così.

O meglio, se la Commissione o magari gli stati singoli possono fare poco, molto può invece essere fatto dalle piattaforme e dalla loro volontà di rendere le arene digitali più sicure e meno inquinate con disinformazione.

Si tratta di tutte decisioni volontarie, come verificare gli account di personalità istituzionali, cooperare con fact-checkers per etichettare notizie che potrebbero non essere vere, o magari controllare il contenuto di contenuti politici sponsorizzati. Soluzioni che, ad esempio, sono suggerite nel Code of practice of disinformation.

Ed è vero che queste misure hanno un impatto sulla libertà di espressione, ma le piattaforme hanno meno vincoli e, in quanto spazi privati, più margine di azione. È il motivo per cui non possiamo troppo lamentarci se Meta decide che su Instagram vedremo meno politica.

Portato questo ragionamento agli estremi, se una piattaforma decide che non si può più parlare di - butto a caso - ciambelle, è una legittima scelta di uno spazio digitale comunque privato.

È ovvio che da questo discendono diversi rischi. Però, per il tema di oggi, deriva anche l’opportunità per cui la lotta alla disinformazione passa anche e soprattutto dalla volontà delle piattaforme di mitigare i rischi che ne derivano.

Può piacere o no. Forse è anche preoccupante per certi versi. Ma rende chiaro che cooperare con le piattaforme è la mossa forse più scaltra ed efficace. Ed è, direi, anche in pieno spirito del DSA.

Storia incredibilmente intricata, quindi voglio sentire la tua:

Save for later

Il nuovo nome di questa sezione è dovuto al fatto che questi sono i classici contenuti che ti salvi per dopo e non riprenderai mai. Ma magari no, eh!

Ma quindi Google sta per rompere il web con l’AI? Non si dica che Artifacts non ne aveva parlato

Qual è il modello di AI più forte? Non lo so, dipende. Ma puoi farli sfidare con questo tool carinissimo.

TikTok cambia spesso idea su cosa consiglia nella guerra tra Israele e Palestina.

Online è pieno di cose finte, quindi questo podcast può essere utile:

Ogni giorno interagiamo con il design di applicazioni, sistemi e altri artefatti con tanti piccoli dettagli che magari non notiamo. Con questo comincerai a notarli.

Aware, che è un think tank amico di Artifacts, cerca un Research Fellow su Digital & ICT, su temi come AI, semiconduttori, space economy etc. Consiglio vivamente di mandare application se interessati :)

Lo Scaffale

Lo sto leggendo ora e quasi finito. “Merchants of truth” racconta le storie parallele di 5 media, più o meno nuovi, e di come si sono inventati o reinventati con Internet. Da leggere, specie se hai più di 30 anni, perché potresti aver visto quelle cose succedere.

📚 Tutti, ma proprio tutti, i libri consigliati in Artifacts sono raccolti qui

Nerding

È arrivato quel periodo dell’anno in cui ti chiedono cosa fai questa estate. Ecco, AskLayla può aiutarti a rispondere: è un chatbot per organizzare vacanze. L’ho usato: direi preciso, forse a volte non trova proprio le offertone. Ma un’occhiata la merita