Alla richiesta di generare un'immagine del Papa, Gemini, il chatbot IA di Google, ha risposto così:

Per dei soldati della Germania del 1943, invece, questo è stato l'esito:

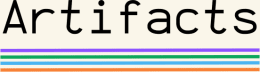

Infine, questi sarebbero i Padri Fondatori degli Stati Uniti:

Tutte immagini storicamente inaccurate o addirittura implausibili. O meglio, se è possibile che ci sarà un Papa nero un giorno, direi che è da escludere che un indiano fosse insieme a Thomas Jefferson e Benjamin Franklin o che una donna giapponese fosse nelle truppe naziste.

Eppure, qualche settimana fa, l'IA di Google ha generato queste immagini, oltre a rifiutarsi di chiarire se fossero più pericolosi i tweet di Elon Musk o le decisioni di Hitler, di generare una posizione di lavoro come lobbista di oil&gas, o anche di fare una campagna di marketing pro consumo di carne.

Gemini è un'attivista woke? No, affatto, nonostante le accuse dei conservatori americani. In primis, come macchina, non può sviluppare valori propri e, soprattutto, queste immagini quantomeno bizzarre sono un errore, umano, di chi l'ha programmata.

Ma allora cos'è successo? Google lo ha chiarito velocemente con 2 ragioni:

il tentativo di considerare criteri di inclusione ha portato ad includere in casi in cui c'è poco da includere (tipo i soldati tedeschi);

col tempo, Gemini è diventata fin troppo cauta, addirittura rifiutandosi di rispondere a certe domande non pericolose (tipo quella del lobbista)

E Google allora ha rimosso l'opzione di generazione immagini da Gemini, che è tuttora indisponibile.

In gergo, l'errore, tutto umano, è quello della "overcompensation": col fine di evitare dei bias conosciuti, si finisce per esagerare, creando situazioni imbarazzanti.

Quali sono questi bias? Il Washington Post ne ha fatto una bella inchiesta su un altro tool IA di generazione immagini, da cui è preso questo:

Ecco, seppur a giocare a calcio siano statisticamente più uomini, non sono SOLO gli uomini a farlo. Sulle pulizie non ho trovato statistiche, ma mi sento di dire che non sia solo una faccenda da donne. Spero.

Ovviamente, non è un problema relativo solo alla generazione di immagini, ma anche a quella di testo. Qualche giorno prima che uscisse ChatGPT nel 2022, avevo fatto un progetto per l'università in cui trovavo che GPT associava aggettivi come “dolce” o “incompetente” con percentuali molto superiori alle donne, mentre “competente” o “violento” erano per gli uomini (tra l'altro ho scoperto ora che è stato ripreso dal Domani!).

Allora, nel tentativo di creare una IA "giusta" (nel senso di "fair", in inglese) a Google hanno cercato di compensare i bias, ma hanno esagerato. E così ne è scaturita non una IA più giusta, ma una che generava immagini con errori fattuali, che non hanno nulla a che fare con valori e principi di uguaglianza o inclusione.

Comunque, al di là di Google, che sta lavorando per sistemare Gemini e della quale va anche apprezzato di aver riconosciuto gli errori, oggi Artifacts si fa una domanda essenziale: Quale realtà vogliamo che sia generata dall'IA?

O meglio, vogliamo che replichi la realtà così com'è, riflettendone ingiustizie o disuguaglianze, o dovremmo piuttosto preferire una realtà a cui aspiriamo, che ci auspichiamo, e verso la quale vorremmo tendere?

Insomma, vogliamo essere dei crassi empiristi attaccati alle statistiche o ricordarci che gli algoritmi, poiché allenati su dati del passato, prossimo o remoto, in realtà tendono a "predire il passato, più che il futuro"?

Complessa, ma proviamoci.

La Storia

Premessa: lascia da parte il caso di Gemini, che è estremo.

La reazione, di pancia, che potrebbe venire è "ok, bello il progresso, ma se la realtà ha determinate caratteristiche, non la cambieremo certo perché le immagini generate dall'IA sono più giuste".

È un pensiero ragionevole, al quale però va contrapposta l'idea che se le cose sono sempre state in una certa maniera - che non ci soddisfa più -, non significa che debbano continuare a esserlo.

Basta astrazione, esempio. Immaginiamo di chiedere ad un'IA di generare un CEO. In inglese, quindi no differenze di genere. Da un lato è vero che la maggior parte dei CEO sono uomini, quindi ha senso che ciò venga riflesso negli output. Dall'altro, le cose - per fortuna - stanno cambiando e continuare a generare uomini CEO sarebbe contrario al cambiamento e, soprattutto, itererebbe uno stereotipo del passato. Sarebbero, quindi, forse preferibili degli output che tengano conto del presente, magari leggermente spostati verso un modello a cui aspiriamo? Insomma, un po' più CEO donne?

La questione è socio-politica, ma è in realtà anche profondamente tecnica. D'altronde, "artifacts do have politics" :).

E pone un interrogativo a chi sviluppa l'IA: preferire modelli e software numericamente accurati, dunque privi di bias statistici ma con bias sociali, oppure "combattere" e limitare i bias sociali ma con ripercussioni sull'accuratezza dei modelli?

Ne potremmo discutere per ore.

La tendenza dell'industria è quella di cercare di controllare e mitigare gli output dell'IA Generativa. Si può fare a priori, manipolando i dati di training o con umani che "correggono" gli output in una fase di test, oppure a posteriori, facendo del "prompt transformation". Ossia, una volta ricevuto un prompt dall'utente, il tool lo "riscrive", sia per dare istruzioni più precise a se stesso che per limare ed evitare casi spiacevoli. Lo fa ChatGPT Plus, e si pensa che lo facesse anche Gemini, con i risultati che abbiamo visto sopra.

A prescindere dalla tecnica, però, un elemento è chiaro: la responsabilità di chi sviluppa l'IA. Dato che, come Floridi spiega bene, la neutralità non esiste, ecco che le aziende tech, come Google o OpenAI, devono capire che realtà vogliono riflettere.

Soprattutto, nel caso di Google, questo viene con un cambiamento radicale: se prima cercavamo la foto di un CEO su Google Search e il risultato erano solo uomini, la responsabilità di Google era limitata al ranking. Ora, invece, l'immagine è generata da un tool sviluppato da Google, quindi c'è molto più margine per prendersela con Google. (Chi sia responsabile degli output dell'IA è questione vasta su cui riflettiamo un'altra volta).

Rispetto alle soluzioni, esistono varie proposte. Per semplificare, vediamo una prima dimensione in cui i tool, quindi le aziende, cercano di defilarsi, e un'altra in cui sono centrali.

Nella prima, che suggerisce Kevin Roose in Hard Fork, l'idea è di lasciare la scelta all'utente e di personalizzare l'uso che fa dell'IA. Ad esempio, se chiediamo una foto dei nostri amati CEO, i tool potrebbero fare domande aggiuntive all'utente per capirne finalità e valori, e quindi generare output adatti alla circostanza. Qui, chiaramente, si rischia di rinforzare agli estremi le visioni degli utenti, ma d'altronde OpenAI produce tecnologia, non un corso di etica.

Nella seconda, invece, le aziende definiscono dei valori per le tecnologie che producono. Quindi non è solo ingegneria informatica, ma anche ingegneria valoriale. In questo modo, fanno ciò di cui Kate Crawford ha scritto come "creazione e perimetrazione della realtà". Inutile dire che qua la responsabilità è tanta tanta.

Alla fine, ne risulta ingigantita l'influenza sulla realtà di aziende private, con i loro legittimi ma privati interessi. Che non è mica una cosa da condannare, ma un fatto di cui è bene essere consapevoli.

E se molto abbiamo scritto e letto del ruolo dei social, e quindi di privati, nel come ci mostravano la realtà, ora si profila uno scenario in cui decifrare quali realtà vengano generate.

Tra l'altro, se è davvero difficile capire che forma dare a queste realtà, è anche importante ricordare che è una decisione comunque in mano ai pochi che la tecnologia la costruiscono. No critica, dato di fatto.

Rassegna (Stampa)

Il giornalismo incontra l’IA, al FT. Ci si chiede se sarà o meno una rivoluzione. Qui una database di tutti i casi di utilizzo finora.

L’UE ha consigliato alle piattaforme come mitigare i rischi durante le elezioni, a partire dal DSA. E Mozilla Foundation ripercorre la storia di tutto quello che hanno fatto le piattaforme negli anni passati.

Perché non dovremmo usare Whatsapp?

OpenAI avrebbe “rubato” i video di YouTube per addestrare la sua IA. Però ha aggiunto una funzione molto carina a DALL-E. Nel frattempo, Google potrebbe mettere la sua IA a pagamento.

Ma cosa stracavolo sono i microchip? Pezzo incredibile del FT

Il problemone dei deepfake. E l’AI Act che ha qualche falla secondo delle organizzazioni civili.

Ma l’IA sa di essere IA? Molto carina questa storia

Ok, bella la privacy, ma se la facciamo rispettare. Ho fatto un video per NOS, con un cookie, basta cliccare :)

Lo Scaffale

Questo prima o poi volevo consigliarlo, è il classico libro per iniziare sull’IA o per avere delle prospettive etiche e filosofiche interessanti. Luciano Floridi e Cabitza sono presumibilmente tra gli italiani più forti sul tema. Breve, si legge in due ore, ma veramente illuminante.

📚 Tutti, ma proprio tutti, i libri consigliati in Artifacts sono raccolti qui

Nerding

Se cerchi ispirazione per visualizzare dei dati, DataViz Project è tra i migliori. Tra l’altro, oltre alla varietà di soluzioni, anche le grafiche sono davvero belle belle.